Entre la proximidad del E3, el conocimiento de que la NX está cada vez más cerca y las patentes que van surgiendo, cada vez estamos más impacientes por saber qué planes tiene la Gran N y con qué nos van a sorprender. A estas alturas seguro que todos habéis visto cuales han sido las patentes pero la pregunta aquí es… ¿las habéis entendido? Si vuestra respuesta es no, entonces os ayudamos a entender en qué consisten exactamente ¡Seguid leyendo!

Primera patente: Procesamiento de imagen

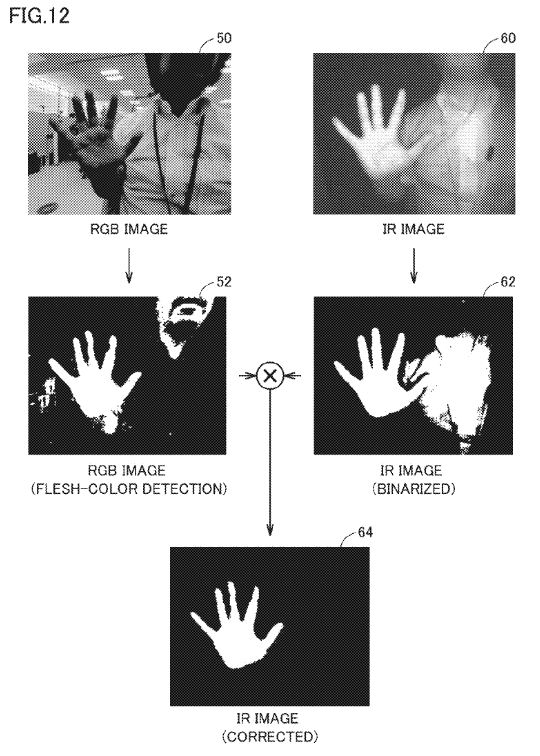

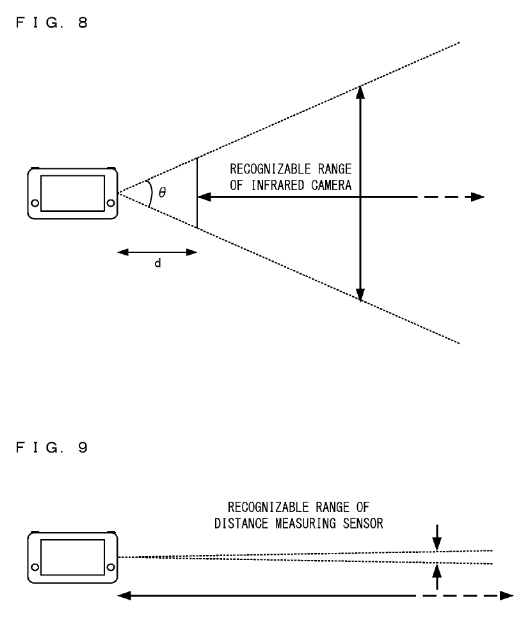

Esta primera patente consiste en un dispositivo capaz de obtener información y buscar ese objeto que deseamos, como vemos en la imagen, la mano (FIG. 1). Para ello, hace uso de dos imágenes (FIG.12), una de color con la que podremos eliminar algunos objetos con colores raros como el verde alien o el rosa fucsia (conseguida con la cámara que todos tenemos en nuestros móviles, webcams, etc… ) y luego otra infrarroja (como la que usa Kinect para reconocer quiénes somos) que nos dice qué profundidad tiene cada objeto. Con estos dos datos llegamos a nuestro objetivo, que es determinar la posición y el área que ocupa dicha mano.

Segunda patente: El dispositivo electrónico

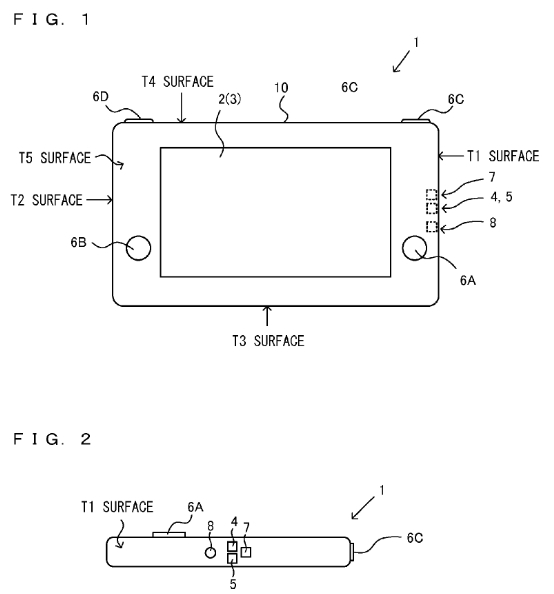

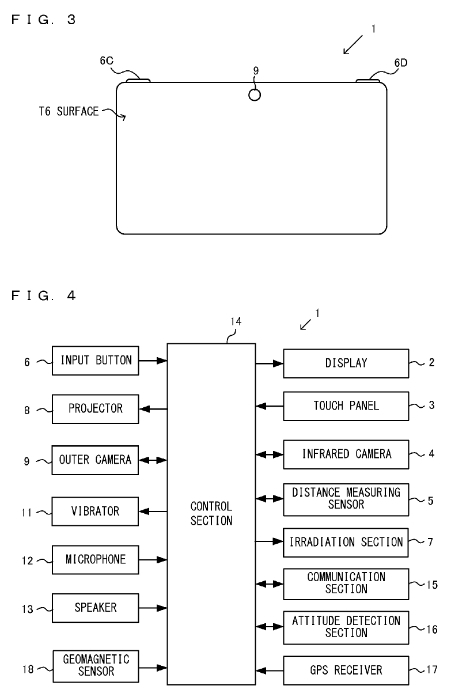

Esta segunda patente se centra en el funcionamiento de lo que podría ser el «Gamepad del futuro», aunque nombrándolo en varias ocasiones como un dispositivo portátil.

En primer lugar, nos describe todos y cada uno de los componentes que conforman este nuevo aparato. Si asociáis el número correspondiente con los que hay en las imágenes entenderéis mejor como están dispuestos.

- Dispositivo

- Pantalla

- Panel táctil

- Cámara infrarroja

- Sensor de distancia

- (A a D) Los botones

- Receptor de infrarrojo

- Proyector

- Cámara trasera

- Carcasa

- Dispositivo vibrador

- Micrófono

- Altavoz

- Sección de control

- Sección de comunicación

- Sección de detección de nuestra actitud

- Receptor GPS

- Sensor geométrico.

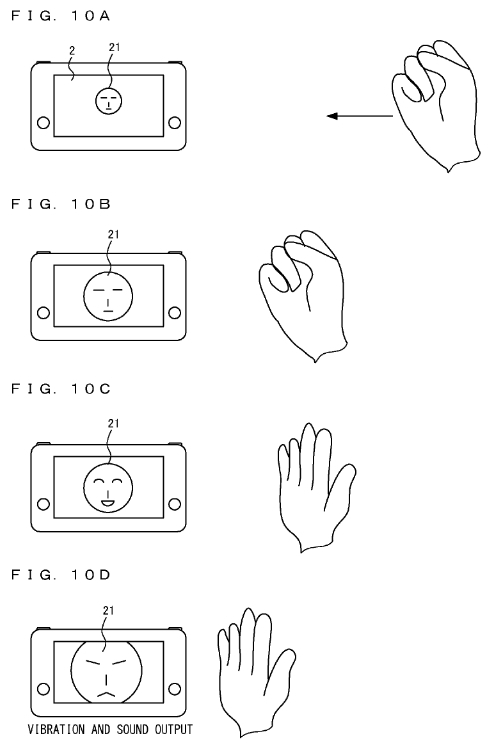

Una vez tenemos claro todo lo que tiene y es capaz de hacer, nos ponen varios ejemplos para que quede más claro el objetivo de todos estos componentes y secciones. El primer ejemplo corresponde con la imagen 10A a 10D, donde nos muestran varias respuestas de la pantalla al hacer el gesto de la piedra y también del papel. Como podéis ver, la expresión cambia al realizar modificaciones y el tamaño de la misma también al acércanos al sensor. Hace falta comentar que en el último ejemplo también vibra el dispositivo y suena un pitido por los altavoces.

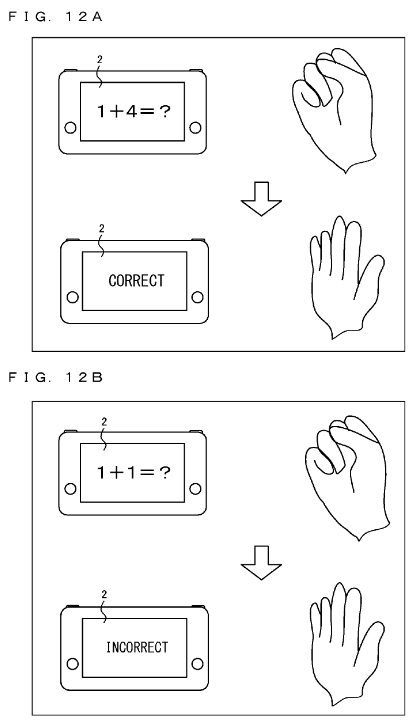

El segundo ejemplo, representado por las figuras 12A y 12B, el dispositivo nos hará una pregunta, en este caso (como se puede ver) una suma. Si mantenemos el gesto de la pierda no daremos ninguna respuesta, hasta que levantemos al menos un dedo, correspondiéndose a la solución del problema. Dependiendo si la solución es correcta o no, variará el resultado de la pantalla. También se hace uso del vibrador y los altavoces.

Los ejemplos de la figura 13 y 14 muestran otra opción que ofrece el sensor situado a la derecha, como son el cálculo de distancias, el cual enseña una serpiente con una posición que dependerá según lo lejos que coloquemos nuestra mano del dispositivo, y un pequeño proyector situado en la misma zona que, aprovechándose de esta cualidad de medir distancias, ajustará el tamaño de la proyección.

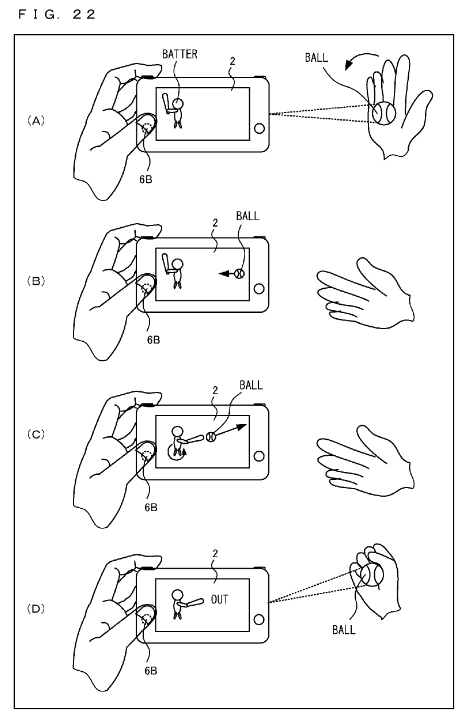

Por último, para que os hagáis una idea de las posibles aplicaciones que tienen todos estos ejemplos que se han puesto, explican cómo sería un juego de baseball donde nosotros seremos el pitcher (o lanzador), con una bola proyectada en nuestra mano. Con un movimiento similar al de lanzar, esa bola aparecerá en la pantalla y el personaje controlado por la IA (u otro jugador) se encargará de batear. Como es de esperar, la bola saldrá de nuevo de nuestro dispositivo y ahora nos toca recogerla con el gesto ya conocido de «roca».

La verdad es que son ideas muy curiosas y sobretodo la posible aplicación final donde Nintendo volvería a apostar por juegos que nos obliguen a realizar movimientos más allá de pulsar simples botones. ¿Qué idea de videojuego se os ocurriría a vosotros?